通說:它的顛覆與人類的可能ChatGPT人工智能(AI)聊天機械人無疑是最近火爆話題,就連新近上映的科幻電影《流浪地球2》也有其身影。 深圳《晶報》“深港書評”欄目主編伍嶺接受香港中通社記者訪問時說,《流浪地球2》裡的MOSS就是聊天機械人。

《流浪地球2》裡的MOSS 科幻文藝中,早就大量出現過聊天機械人的身影。身為文化評論人的伍嶺回憶起電影《機械姬》,講的就是一種人形的“ChatGPT”,但其智能程度遠超目前人類所認識的ChatGPT。 “機械姬能偽裝、欺騙,具有人類的心機與城府,當然也有人類無法比擬的學習能力。電影結局是機械姬逃出‘牢籠’,扮演著真正的人類生活在現實世界裡。” CharGPT為代表的聊天機械人彰顯了當下科技前沿,那麼像“機械姬”這樣超越人類的AI有朝一日會成為現實,并真正威脅到人類嗎?伍嶺覺得只是時間的問題。 盡管想像此般未來圖景令人有點無措,伍嶺還是能看到人類妥善應對之道。他說,重視科學倫理才是有效規約科技發展的手段。 高科技剽竊爭議 回歸現實,誕生不足三個月的ChatGPT無疑給人類科技史帶來質的飛躍,而且正被充分挖掘其潛在用途,包括用來代寫程式、寫小說、分析大數據等,甚至學生有可能用此工具代寫心得、自傳、論文等。

香港中通社圖片 然而,ChatGPT在全世界火熱的同時,爭議也越來越大。各國教育部門普遍對ChatGPT持謹慎態度。批評者指,這是一種“高科技剽竊”和“避免學習的方式”。 海外有一項對1000多名學生展開的調查顯示,超過89%的學生使用ChatGPT來幫助完成家庭作業。 目前,美國多所公立學校已經禁用了ChatGPT,原因是擔心學生作弊。多家科學期刊也禁止將ChatGPT列為論文“合著者”。 香港近日也有學生群體利用其撰寫論文等,引發教育界關注。香港大學日前開出第一槍,禁止所有課堂、作業和考試使用ChatGPT或其他AI工具。 ChatGPT真的無所不能? 香港市民謝銀泉從事文職工作數十年,現擔任香港行政管理文職人員協會秘書長。他意識到這次AI聊天機械人面世是科技進程“質”的改變。接受香港中通社記者採訪時,泉哥連日來與ChatGPT類聊天機械人對話,已窺探到聊天機械人的能力和限制,也由此預見聊天機械人未來對生活、工作的影響。

香港中通社圖片 他先是向聊天機械人詢問日常話題如健康、投資等,均能立刻引用相關資料并梳理,給出答案,總體而言值得參考,但不時會提出“免責聲明” ,譬如說投資有風險,要問專家、看自己能力等。 根據泉哥的體驗,聊天機械人不同於現有的搜索引擎,不是只推送許多鏈接讓用戶自行比較,而是回答它認為最優的答案。即使現階段也會給出不正確信息,但不失為可啟發思考。 在日常工作中,泉哥從英文報刊複制全篇英文報道輸入,請聊天機械人譯成中文,同時做好撮要,大約一分鐘,十幾行較為流暢的中文字已在眼前。由此看出ChatGPT類聊天機械人今後可很大程度提高辦公效率。 “AI機械人回答問題較為詳細,態度則較平和,的確適合商業用途。”泉哥可設想一些辦公中使用聊天機械人的場景,“譬如一場公司會議,AI機械人也一起開,開完它已寫好會議報告。很快,準確度也高。”泉哥覺得聊天機械人潛力無限。

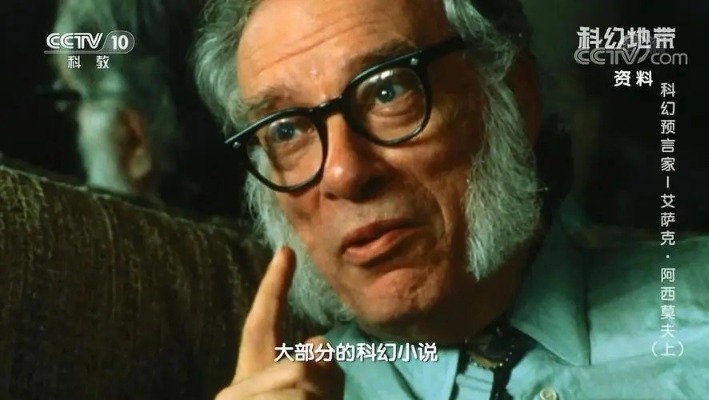

香港中通社圖片 近日一直有聲音表示,ChatGPT的研發公司OpenAI及其主要投資和技術支持方微軟還有推出“定制版”ChatGPT的計劃。 “定制版”ChatGPT等聊天機械人應已離我們不遠,它們會有“個性”、守規則嗎?會不會企圖顛覆人類制定的法則? 美籍俄裔科幻小說家阿西莫夫1950年出版了《我,機械人》一書,引言強調他創造的“機械人學三大法則”—— 第一定律:機械人不得傷害人類個體,或者目睹人類個體將遭受危險而袖手不管; 第二定律:機械人必須服從人給予它的命令,當該命令與第一定律衝突時例外; 第三定律:機械人在不違反第一、第二定律的情況下要盡可能保護自己的生存。 如今看來,逾半世紀前的文學創作就快成為現實命題。 【編輯:黎金良】

|